Samsung “เริ่มส่งมอบ HBM4” อย่างเป็นทางการ

Samsung ออกประกาศว่าได้เริ่มส่งมอบหน่วยความจำ HBM4 เชิงพาณิชย์แล้ว โดยชูจุดขายหลักคือ “ความเร็วต่อพิน (pin speed)” ที่ทำได้ 11.7 Gbps และสามารถ “เพิ่มเพดาน” ได้ถึง 13 Gbps เพื่อช่วยลดคอขวดการป้อนข้อมูลให้ AI accelerator ในยุคที่โมเดล AI โตขึ้นเรื่อย ๆ

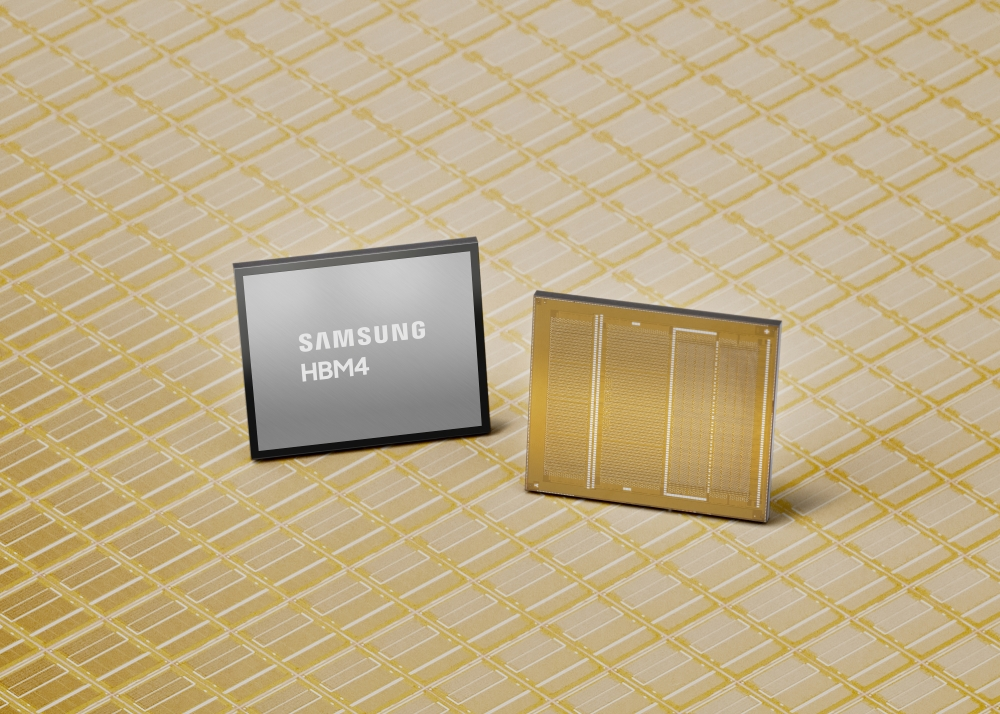

ในประกาศเดียวกัน Samsung ระบุว่า HBM4 รุ่นนี้มาพร้อมการสแต็ก 12-layer (ความจุ 24–36GB ต่อสแต็ก) และวางแผนขยายไปสแต็ก 16-layer เพื่อดันความจุเป็น 48GB ต่อสแต็ก ในอนาคต

หมายเหตุเรื่อง “ลูกค้า”: Samsung ไม่เปิดชื่อว่าจัดส่งให้ใคร แต่ Reuters ระบุว่าบริษัทกำลังเร่งไล่ตามคู่แข่งในตลาด HBM ที่เป็นชิ้นส่วนสำคัญสำหรับ AI accelerator ของ NVIDIA

HBM และ HBM4 คืออะไร ทำไมถึงเป็น “ตัวแปรใหญ่” ของ AI

HBM (High Bandwidth Memory) คือหน่วยความจำแบนด์วิดท์สูงที่ออกแบบมาเพื่อ “ป้อนข้อมูลจำนวนมหาศาล” ให้ GPU/AI accelerator ได้เร็วมาก โดยจุดเด่นคือการวางชิปหน่วยความจำแบบ ซ้อนชั้น (stacking) ใกล้ ๆ กับชิปประมวลผล และเชื่อมต่อด้วยอินเทอร์เฟซที่กว้างกว่าหน่วยความจำทั่วไป ทำให้ได้แบนด์วิดท์สูง เหมาะกับงาน AI ทั้งฝั่งเทรน (training) และรันโมเดล (inference)

สำหรับ HBM4 คือเจเนอเรชันถัดจาก HBM3E ที่มักถูกพูดถึงในบริบท “ยุคต่อไปของ AI data center” เพราะ AI รุ่นใหม่ไม่ได้ติดแค่พลังประมวลผลของ GPU อย่างเดียว แต่ติด “การป้อนข้อมูลเข้า GPU” ด้วย—และนี่คือสิ่งที่ HBM ถูกยกให้เป็นหัวใจของระบบ

สเปกเด่นของ HBM4 ที่ Samsung ประกาศ

จากประกาศของ Samsung Global Newsroom มีตัวเลขสำคัญที่ทำให้ HBM4 รอบนี้ถูกจับตามากขึ้น ได้แก่

- ความเร็วต่อพิน 11.7 Gbps (สูงกว่า “มาตรฐานอุตสาหกรรม 8 Gbps” ราว 46%)

- เพิ่มได้ถึง 13 Gbps (Samsung อธิบายว่าเป็นเพดานที่ช่วยลด data bottleneck เมื่อโมเดล AI ขยายตัว)

- แบนด์วิดท์รวมต่อสแต็กสูงสุด 3.3 TB/s และระบุว่าเพิ่มขึ้น 2.7 เท่า เมื่อเทียบกับ HBM3E

- 12-layer: 24–36GB ต่อสแต็ก

- 16-layer: ขยายได้ถึง 48GB ต่อสแต็ก

- Samsung ยังพูดถึงการรับมือด้านพลังงาน/ความร้อน จากการเพิ่มจำนวน I/O (เช่น การเพิ่มพินจาก 1,024 เป็น 2,048) และอ้างว่ามีการปรับปรุงด้านประสิทธิภาพพลังงานเมื่อเทียบกับ HBM3E

ส่วนมุม “ไทม์ไลน์และการจัดส่ง” Reuters รายงานว่า Samsung เริ่มส่งมอบ HBM4 ให้ลูกค้า (ไม่ระบุชื่อ) แล้ว พร้อมย้ำตัวเลข 11.7 Gbps และเพดาน 13 Gbps เช่นกัน

ทำไม “ความเร็วต่อพิน” และ “แบนด์วิดท์” ถึงสำคัญกับ GPU งาน AI

เวลาพูดถึงระบบ AI ระดับ data center หลายคนจะนึกถึงจำนวนคอร์/TFLOPS แต่ในชีวิตจริง “ความเร็วในการป้อนข้อมูล” มักเป็นคอขวดที่ทำให้ GPU แรงแค่ไหนก็ใช้ได้ไม่เต็มที่

- Pin speed (Gbps) เปรียบได้กับ “ความเร็วของเลนข้อมูล” ต่อเส้นสัญญาณ

- Bandwidth (TB/s) คือ “ปริมาณข้อมูลรวมที่ส่งได้ต่อวินาที” ซึ่งขึ้นกับทั้งความเร็วและจำนวนเส้นทางข้อมูล

ถ้า GPU ต้องรอข้อมูล (เช่น weight, activation, หรือข้อมูลสำหรับ attention) ประสิทธิภาพจริงจะดรอปลงทันที ดังนั้นการขยับจาก HBM3E → HBM4 จึงไม่ใช่แค่ “ตัวเลขสวย” แต่เป็นการลดโอกาสที่ระบบจะคอขวดตรงหน่วยความจำ—ซึ่งเป็นสิ่งที่ผู้ให้บริการ AI และผู้สร้าง infrastructure ให้ความสำคัญมากขึ้นเรื่อย ๆ

แล้วมันเกี่ยวกับ NVIDIA Vera Rubin แค่ไหน?

ต้องแยกเป็น 2 ชั้นให้ชัดเจน:

(ก) ข้อเท็จจริง: Vera Rubin ใช้ HBM4

NVIDIA เองได้เปิดตัวแพลตฟอร์ม Vera Rubin และระบุชัดว่าระบบในตระกูลนี้ใช้ HBM4 เป็นหน่วยความจำหลัก โดยเริ่มทยอยออกสู่พาร์ตเนอร์ใน ครึ่งหลังปี 2026

(ข) สิ่งที่ “ยังไม่ยืนยัน”: HBM4 ของ Samsung ที่ส่งมอบรอบนี้ “เข้า Rubin แล้ว” หรือยัง

Samsung ในประกาศไม่ได้บอกชื่อผู้ซื้อ/ผู้ใช้งานปลายทาง แต่ Reuters รายงานบริบทว่าชิ้นส่วนประเภทนี้เป็นส่วนสำคัญสำหรับ AI accelerator ของ NVIDIA และ Samsung กำลังไล่ตามคู่แข่งในตลาด HBM

ดังนั้น “ภาพที่ใกล้เคียงความจริงที่สุด” ณ ตอนนี้คือ:

- Rubin ต้องใช้ HBM4 แน่นอน (ยืนยันได้จากฝั่ง NVIDIA)

- Samsung เริ่มส่งมอบ HBM4 ให้ลูกค้าแล้ว แต่ ไม่ยืนยันว่าคือลูกค้ารายไหน

- สื่อเทคหลายสำนักจึงมองว่า นี่คือ “การปูทาง” เพื่อกลับมาอยู่ในซัพพลายเชนของ NVIDIA สำหรับยุค Rubin/Vera Rubin

เกมการแข่งขัน HBM4: Samsung vs SK hynix vs Micron

Reuters สรุปภาพการแข่งขันค่อนข้างชัดว่า “ตลาด HBM กำลังเดือดกว่าเดิม” โดย SK hynix ยังเป็นผู้นำ และประกาศเป้าหมายรักษาความเป็นผู้นำใน HBM4 ขณะที่ Micron ก็ระบุว่าอยู่ในช่วงผลิตระดับ high-volume และเริ่มจัดส่งให้ลูกค้าแล้วเช่นกัน

ในมุมของ Samsung การประกาศ “เริ่มส่งมอบเชิงพาณิชย์” และตัวเลข 11.7→13 Gbps คือการส่งสัญญาณว่า บริษัทกลับมาชนเต็มตัวในตลาดที่เป็นหัวใจของ AI data center อีกครั้ง

HBM4E ครึ่งหลังปี 2026 คืออะไร และทำไมต้องจับตา

นอกจาก HBM4 แล้ว Reuters ระบุด้วยว่า Samsung มีแผน “ส่งตัวอย่าง” HBM4E ใน ครึ่งหลังปี 2026

โดยทั่วไป HBM4E มักถูกมองว่าเป็นรุ่น “ต่อยอด/ปรับปรุง” ของ HBM4 เพื่อดันประสิทธิภาพและความพร้อมในการผลิตให้สูงขึ้น (รายละเอียดเชิงสเปกสุดท้ายขึ้นกับแต่ละผู้ผลิตและการรับรองของลูกค้า)

สิ่งที่น่าจับตาจริง ๆ สำหรับตลาดคือ:

- การส่งตัวอย่าง HBM4E เร็วแค่ไหน

- อัตรา yield และความพร้อมในการผลิตจำนวนมาก

- รายชื่อลูกค้าระดับท็อปที่จะ “ผ่านคุณสมบัติ” (qualification) และรับของเข้าซัพพลายเชนจริง

สรุป: ทำไมข่าวนี้สำคัญกับโลก AI

- HBM4 ไม่ใช่แค่ “แรมแรงขึ้น” แต่คือการลดคอขวดของ GPU/AI accelerator ในยุคที่โมเดล AI โตแบบก้าวกระโดด

- Samsung ส่งสัญญาณชัดว่า “กลับมาสู้ในตลาด HBM” ด้วยการเริ่มส่งมอบเชิงพาณิชย์ และชูตัวเลข 11.7 Gbps (แตะ 13 Gbps)

- ฝั่ง NVIDIA ยืนยันแล้วว่า Vera Rubin ใช้ HBM4 และเริ่มทยอยออกสู่พาร์ตเนอร์ครึ่งหลังปี 2026 ดังนั้นซัพพลาย HBM4 ในปีนี้–ปีหน้าจะยิ่งเป็น “สมรภูมิหลัก”

- ส่วนประเด็น “HBM4 ของ Samsung เข้า Rubin แล้วหรือยัง” ตอนนี้ยังเป็นระดับ “คาดการณ์จากบริบทตลาด” เพราะ Samsung ไม่เปิดชื่อผู้รับสินค้า—แต่ Reuters ก็ชี้ว่าความต้องการหลักมาจากตลาด AI accelerator ของ NVIDIA และการแข่งขันกำลังเร่งขึ้น

ที่มา: wccftech