อุตสาหกรรม AI กำลังเดินเข้าสู่ช่วงเปลี่ยนผ่านครั้งสำคัญ จากยุคที่เน้นการ “ฝึกโมเดล (training)” ไปสู่ยุคที่เน้น “การใช้งานจริง (inference)” มากขึ้น และการเปลี่ยนแปลงครั้งนี้กำลังส่งผลกระทบโดยตรงต่อโครงสร้างฮาร์ดแวร์ของ data center ทั่วโลก

รายงานล่าสุดจากสื่อเกาหลีใต้ระบุว่า NVIDIA และ SK hynix กำลังร่วมมือกันพัฒนาโซลูชันจัดเก็บข้อมูลรูปแบบใหม่ที่เรียกว่า AI SSD ซึ่งออกแบบมาเพื่อรองรับงาน inference โดยเฉพาะ และอาจมีประสิทธิภาพสูงกว่า SSD ระดับองค์กรในปัจจุบันถึง 10 เท่า

ที่น่าจับตามองไม่แพ้กันคือ หากเทคโนโลยีนี้ถูกนำมาใช้งานจริงในวงกว้าง อุตสาหกรรม NAND Flash อาจต้องเผชิญสถานการณ์ตึงตัวแบบเดียวกับที่ DRAM กำลังเจออยู่ในขณะนี้

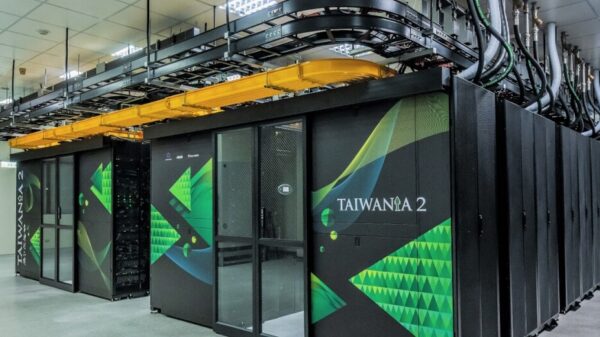

จากยุค Training สู่ยุค Inference โครงสร้างฮาร์ดแวร์ต้องเปลี่ยน

ในช่วงหลายปีที่ผ่านมา การพัฒนา AI ส่วนใหญ่เน้นไปที่การฝึกโมเดลขนาดใหญ่ ซึ่งต้องพึ่งพา HBM และ DRAM ปริมาณมหาศาล แต่เมื่อ AI ถูกนำไปใช้งานจริงมากขึ้น ไม่ว่าจะเป็น chatbot, search engine, recommendation system หรือ AI assistant ในองค์กร งาน inference กลับกลายเป็นภาระหลักแทน

ปัญหาคือ โมเดล AI ขนาดใหญ่ในปัจจุบันมี พารามิเตอร์จำนวนมหาศาล ซึ่งไม่สามารถเก็บทั้งหมดไว้ใน HBM หรือ DRAM ได้ตลอดเวลา ส่งผลให้ระบบต้องดึงข้อมูลจาก storage อย่างต่อเนื่อง และตรงจุดนี้เองที่ SSD แบบเดิมเริ่มกลายเป็นคอขวด

AI SSD คืออะไร และทำไม NVIDIA ถึงสนใจจริงจัง

ตามรายงานระบุว่า NVIDIA และ SK hynix กำลังพัฒนาโครงการภายในที่ใช้ชื่อว่า “Storage Next” โดยมีเป้าหมายสร้าง AI SSD ที่ทำหน้าที่เป็นเหมือน “ชั้นหน่วยความจำเสมือน (pseudo-memory layer)” ระหว่าง DRAM กับ storage แบบเดิม

จุดเด่นสำคัญของ AI SSD ที่กำลังถูกพูดถึง ได้แก่

- ประสิทธิภาพระดับ 100 ล้าน IOPS

- เร็วกว่า SSD องค์กรทั่วไปในปัจจุบันประมาณ 10 เท่า

- ออกแบบสถาปัตยกรรม NAND และ controller ใหม่ เพื่อรองรับ workload ของ AI โดยตรง

- เน้น latency ต่ำ และ throughput สูง สำหรับงาน inference

หากตัวเลขนี้เกิดขึ้นจริง จะถือเป็นการยกระดับบทบาทของ SSD จากอุปกรณ์จัดเก็บข้อมูล ไปสู่ส่วนหนึ่งของโครงสร้างหน่วยความจำสำหรับ AI อย่างแท้จริง

SK hynix ตั้งเป้าโชว์ต้นแบบ AI SSD ภายในปีหน้า

แหล่งข่าวระบุว่า SK hynix มีแผนเปิดตัวต้นแบบ AI SSD ภายในช่วงปลายปีหน้า และตั้งเป้าพร้อมใช้งานเชิงพาณิชย์ราวปี 2027

ความร่วมมือกับ NVIDIA ในครั้งนี้ ไม่ได้จำกัดแค่ตัว NAND Flash เท่านั้น แต่ยังรวมถึงการพัฒนา controller, firmware และสถาปัตยกรรมพลังงาน เพื่อให้ได้ทั้งประสิทธิภาพสูงและประหยัดพลังงาน เหมาะกับ data center ขนาดใหญ่ที่ต้องคุมต้นทุนค่าไฟอย่างเข้มงวด

สัญญาณเตือน NAND Flash อาจซ้ำรอย DRAM

แม้ AI SSD จะดูเป็นโอกาสครั้งใหญ่ของอุตสาหกรรม storage แต่ในอีกมุมหนึ่ง นี่คือ สัญญาณเตือนด้าน supply chain ที่ไม่ควรมองข้าม

ปัจจุบัน NAND Flash เริ่มเผชิญแรงกดดันจากหลายทิศทางพร้อมกัน ได้แก่

- ความต้องการ storage จาก CSP และ hyperscaler

- การขยาย data center เพื่อรองรับ AI

- การฟื้นตัวของตลาด consumer electronics บางส่วน

หาก AI SSD กลายเป็นมาตรฐานใหม่ใน data center จริง ความต้องการ NAND อาจพุ่งสูงในระดับเดียวกับ DRAM ที่กำลังขาดตลาดอยู่ในขณะนี้ ซึ่งอาจนำไปสู่

- ราคาสัญญา NAND ปรับขึ้นต่อเนื่อง

- ผู้ผลิต prioritise ตลาด AI มากกว่าผู้บริโภคทั่วไป

- SSD สำหรับ consumer และองค์กรทั่วไปมีต้นทุนสูงขึ้น

ผลกระทบต่อผู้ใช้ทั่วไป

แม้ AI SSD จะเป็นเทคโนโลยีระดับ data center แต่ผลกระทบทางอ้อมอาจมาถึงผู้ใช้ทั่วไปได้เช่นกัน ไม่ว่าจะเป็น

- ราคา SSD และอุปกรณ์ storage ปรับตัวสูงขึ้น

- โน้ตบุ๊กและพีซีระดับ consumer ถูกลดสเปก storage เพื่อคุมราคา

- ตลาดองค์กรต้องแบกรับต้นทุนเพิ่ม ซึ่งสุดท้ายอาจสะท้อนกลับมาที่ผู้บริโภค

ในบริบทไทย หากราคาชิ้นส่วนปรับขึ้นในระดับสากล ก็มีโอกาสเห็น SSD ความจุยอดนิยมปรับราคาขึ้นหลัก หลายร้อยถึงหลักพันบาท ต่อรุ่น ขึ้นอยู่กับสถานการณ์ supply ในแต่ละช่วง

AI เดินหน้า แต่ต้นทุนของระบบก็สูงขึ้นตาม

กรณีของ AI SSD สะท้อนภาพรวมอุตสาหกรรมได้อย่างชัดเจนว่า การขับเคลื่อน AI ไม่ได้เกิดขึ้นฟรี ๆ ทุกการเพิ่มประสิทธิภาพย่อมมาพร้อมต้นทุนที่ส่งแรงกระเพื่อมไปทั้ง ecosystem ตั้งแต่ผู้ผลิตชิป ไปจนถึงผู้ใช้ปลายทาง

หลังจาก DRAM เข้าสู่ภาวะตึงตัวจาก AI ไปแล้ว ดูเหมือนว่า NAND Flash อาจเป็นรายต่อไป ที่ต้องรับแรงกดดันอย่างเต็มรูปแบบในอีกไม่กี่ปีข้างหน้า

หาก AI SSD ของ NVIDIA และ SK hynix ประสบความสำเร็จจริง นี่อาจเป็นทั้ง “โอกาสทอง” และ “ความท้าทายครั้งใหญ่” ของอุตสาหกรรม storage ในเวลาเดียวกัน

ที่มา: wccftech